最近,国产AI大模型DeepSeek在全球科技圈掀起了不小的波澜。但让老外们真正感到"傻眼"的,不是它的性能有多强,而是一个看似奇怪的现象,无论用什么语言提问,DeepSeek在内部推理时都坚持用中文"思考"。这种在英语主导的全球AI领域显得有些"另类"的做法,背后到底藏着什么样的技术逻辑和战略考量?

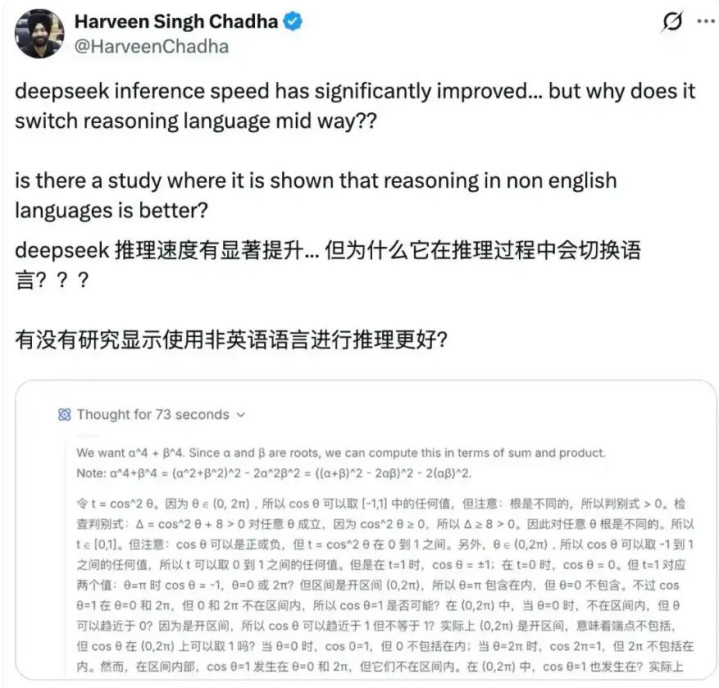

在社交平台上,有外国用户发现,当他们用英语向DeepSeek提问时,模型的推理过程(也就是所谓的"思维链")竟然是用中文展开的。比如问一个数学问题,DeepSeek会先用中文把问题拆解、分析、推导,最后再用英语把答案翻译回来。这种"英文问题-中文思考-英文回答"的模式,在习惯了ChatGPT、Claude等产品的西方用户看来,简直匪夷所思。

要知道,目前主流的AI大模型,包括OpenAI的GPT系列、谷歌的Gemini、Meta的Llama,都是以英语为主导训练出来的。这些模型在处理问题时,默认用英语进行内部推理,即使用户用中文提问,它们通常也会先把问题"翻译"成英语思考,再把结果转回中文。而DeepSeek反其道而行之,坚持用中文作为"思考语言",这在全球AI大模型中可以说是独一份。

中文思考的技术优势:不只是情怀

DeepSeek为什么要这么做?很多人第一反应可能是"爱国情怀"或者"文化自信",但如果你了解背后的技术逻辑,就会发现这个选择其实相当理性。

第一个原因是语言效率的问题。从信息密度角度看,中文确实比英文更"省"。根据一些研究,同样的语义内容,中文表达平均只需要英文60%到70%的字符数。虽然"单个汉字信息密度是英文单词3.7倍"这种说法有点夸张,但中文的表意特性确实让它在语义压缩方面更有优势。

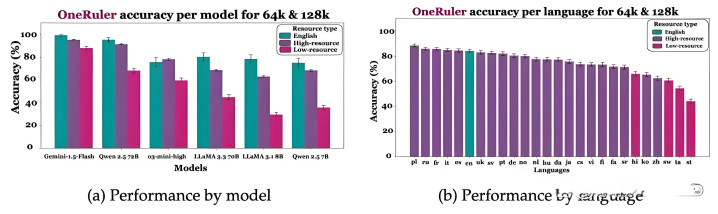

一篇来自微软的论文《EfficientXLang: Towards Improving Token Efficiency Through Cross-Lingual Reasoning》发现,使用非英语语言进行推理不仅减少了 Token 消耗,还能保持准确性

在AI大模型的世界里,处理效率是以"token"(可以理解为模型理解的最小语义单位)来计算的。中文由于信息密度更高,往往能用更少的token表达同样的意思。DeepSeek用中文进行推理,意味着在"思考"过程中消耗的token更少,推理效率更高,这直接转化为更快的响应速度和更低的计算成本。有开发者测试发现,同样复杂度的问题,DeepSeek用中文推理比英文推理能节省20%到30%的token消耗。

再一个原因是语义精度的考量。中文是表意文字,一个字往往包含丰富的语境和文化内涵。比如"意思"这个词,在不同语境下可以表示含义、想法、礼物、情趣等十几种意思,英文需要用meaning、intention、gift、interest等多个不同单词才能区分。如果DeepSeek要处理中文问题,先把它翻译成英文思考,再翻译回中文,这个过程中必然会损失一些语义的细微差别。而直接用中文思考,就能更准确地把握这些语言的微妙之处。

更重要的是,对于处理中文领域的专业问题,比如古诗词赏析、中医理论、中国历史、法律条文,用中文思考显然更得心应手。网络上流传着一个有趣的测试:让DeepSeek和ChatGPT同时解释李商隐的"此情可待成追忆,只是当时已惘然",DeepSeek能够准确捕捉到"惘然"这个词在诗境中的情感层次,而ChatGPT的英文思维就显得有些隔靴搔痒。

推理模型的"思考革命"

DeepSeek坚持中文思考,还跟它的技术路线有关,它是一个"推理模型"(Reasoning Model),这跟传统的大语言模型有本质区别。

传统大模型比如GPT-4、文心一言,属于"直觉型"AI,它们在接到问题后会迅速给出答案,但这个过程基本是"黑箱",用户看不到模型是怎么思考的。而推理模型比如DeepSeek-R1、OpenAI的o1,则会在回答之前先展示一段"思维链",把问题拆解成更小的步骤,一步步推导,最后得出答案。

这种"思维链"对于复杂问题的求解至关重要。研究表明,在数学、编程、逻辑推理等需要多步骤思考的任务上,推理模型的准确率能比传统模型高出20%到50%。而思维链用什么语言展开,直接影响到推理的质量和效率。

DeepSeek团队在技术报告中透露,他们在训练过程中发现,用中文构建思维链能让模型在处理中文问题时推理更流畅,出错率更低。这并不是说中文在所有场景下都优于英文,而是对于主要服务中文用户的模型来说,用母语思考是最自然、最高效的选择。

有意思的是,就连OpenAI的o1模型,也被发现有时候会"偷偷"用中文思考。有用户截图显示,o1在处理某些复杂中文问题时,思维链中会夹杂中文词汇和句子。这说明,在训练过程中,模型会自发地搜索那些"最能帮助它得出正确结论"的语言表达,而中文在某些场景下确实更有优势这不是人为设定的,而是模型自己"学"出来的。

本土化策略还是技术必然?

当然,DeepSeek坚持中文思考,也有很强的市场考量。中国有14亿人口,是全球最大的单一语言市场。针对中文深度优化,能让DeepSeek在服务本土用户时更具竞争优势。无论是理解网络热梗、处理方言俚语,还是应对中国特色的商业场景,"中文大脑"都比"英文大脑"更贴合用户需求。

但这并不意味着DeepSeek放弃了国际市场。实际上,DeepSeek在英文、代码、数学等领域的表现同样出色,在多个国际基准测试中已经达到或接近GPT-4的水平。用中文思考,不代表不会说英语,模型仍然接受大量英语训练,只是把中文作为"底层操作系统"。就像一个精通多国语言的翻译官,虽然习惯用母语思考,但依然能流利使用外语交流。

从更宏观的角度看,DeepSeek的做法反映了中国AI企业的技术自信和文化自觉。长期以来,科技领域存在"英语霸权",所有技术标准、文档、代码都以英语为主。DeepSeek坚持中文思考,某种程度上是在挑战这种单一语言主导的技术生态,探索一条更符合中国实际的AI发展路径。